在Claude 3.5 Sonnet之前,这些AI Agent已能像人类一样操作电脑

在Claude 3.5 Sonnet之前,这些AI Agent已能像人类一样操作电脑这两天,Claude 3.5 Sonnet升级版刷爆了朋友圈,满屏都是:它能像人一样操作电脑。 大语言模型(Large Language Model,LLM)能够像人一样操作电脑这件事,看起来蛮炸裂的,但在AI Agent圈子里早已经见多不怪了。

搜索

搜索

这两天,Claude 3.5 Sonnet升级版刷爆了朋友圈,满屏都是:它能像人一样操作电脑。 大语言模型(Large Language Model,LLM)能够像人一样操作电脑这件事,看起来蛮炸裂的,但在AI Agent圈子里早已经见多不怪了。

国庆节过后,人工智能领域似乎多了几分冷色调。不知道是因为大语言模型(Large Language Model,LLM)的幻觉,还是因为寒露时节的到来。

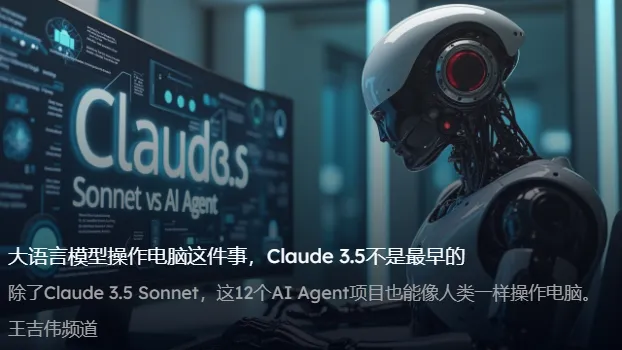

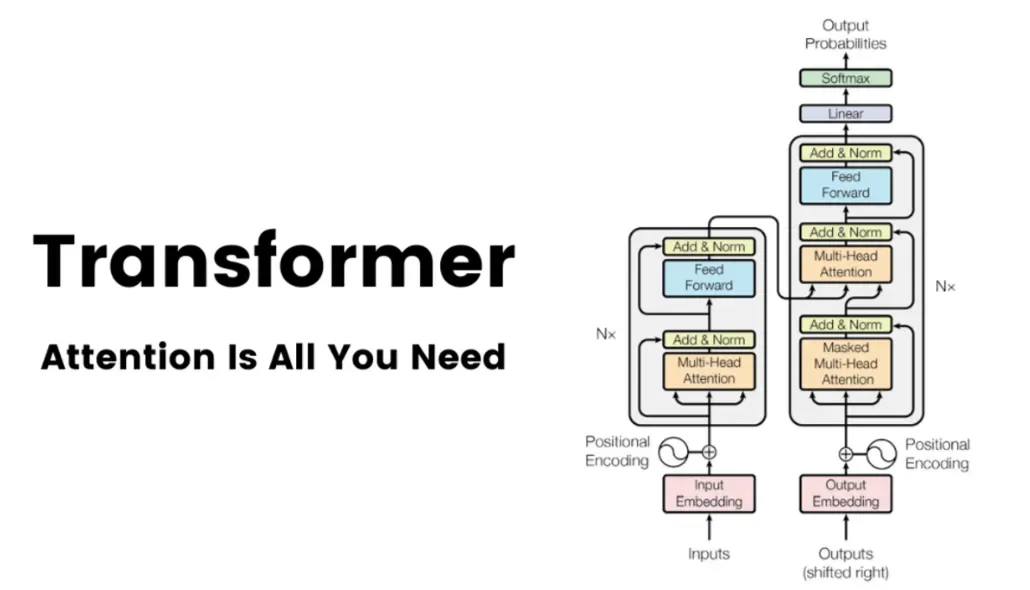

大语言模型(Large Language Models, LLMs)的强大能力推动了 LLM Agent 的迅速发展。围绕增强 LLM Agent 的能力,近期相关研究提出了若干关键组件或工作流。然而,如何将核心要素集成到一个统一的框架中,能够进行端到端优化,仍然是一个亟待解决的问题。

近日,清华大学电子系城市科学与计算研究中心的研究论文《EconAgent: Large Language Model-Empowered Agents for Simulating Macroeconomic Activities》获得自然语言处理顶会 ACL 2024杰出论文奖(Outstanding Paper Award)。

在过去的几年中,大型语言模型(Large Language Models, LLMs)在自然语言处理(NLP)领域取得了突破性的进展。这些模型不仅能够理解复杂的语境,还能够生成连贯且逻辑严谨的文本。

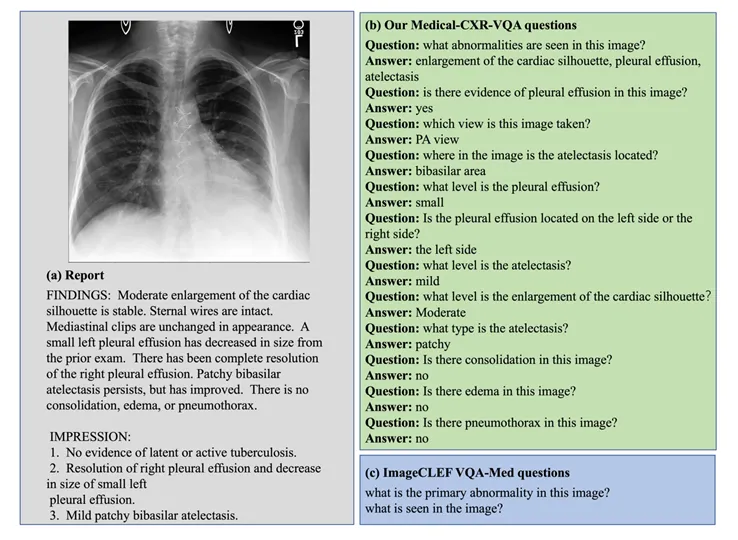

多模态大语言模型 (Multimodal Large Language Moodel, MLLM) 以其强大的语言理解能力和生成能力,在各个领域取得了巨大成功。

从前两年的百模大战到大语言模型 LLM(Large Language Model)的逐步落地应用,端侧AI始终是人工智能技术发展中至关重要的一环。 所谓的端侧AI,即用户在使用过程中不依赖云服务器,直接在终端设备本地使用AI服务。相比于ChatGPT4.0和最新推出的Llama3.1等依赖于云端接口的主流大语言模型,设备端边缘应用的紧凑模型有较强的私密性,也具有个性化操作和节省成本等诸多优势。

多模态大模型(Multimodal Large Language Models,MLLMs)在不同的任务中表现出了令人印象深刻的能力,尽管如此,这些模型在检测任务中的潜力仍被低估。

基于 ChatGPT、LLAMA、Vicuna [1, 2, 3] 等大语言模型(Large Language Models,LLMs)的强大理解、生成和推理能力

最近两天,一篇入选 ACL 2024 的论文《Can Language Models Serve as Text-Based World Simulators?》在社交媒体 X 上引发了热议,就连图灵奖得主 Yann LeCun 也参与了进来。